Darum geht’s:

- User nehmen KI-Fakes oft nicht als echt wahr – begrüßen aber ihre Botschaft.

- Häufig ist das Propaganda. Sie bestärkt Vorurteile und ein Freund-Feind-Denken.

- Denkfallen wie der Confirmation Bias können aber auch dazu führen, dass man manipulierte oder KI-erstellte Bilder für echt hält.

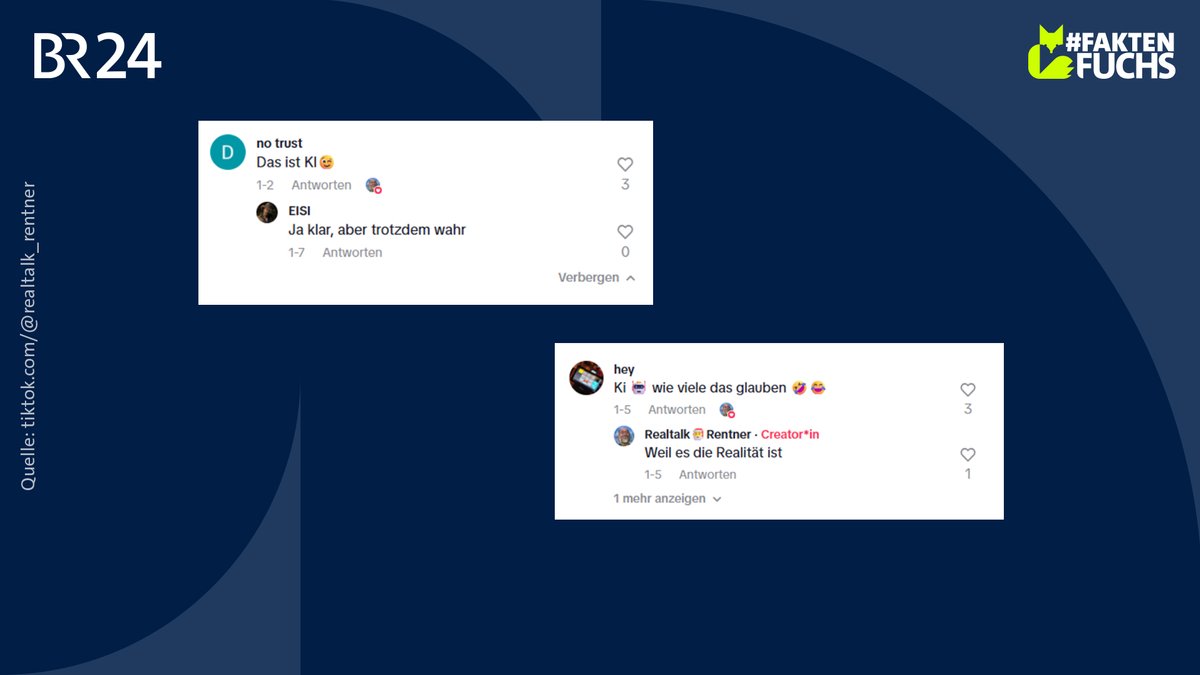

"Das ist KI", schreibt ein User zu einem Video auf TikTok. "Ja klar, aber trotzdem wahr", antwortet ein anderer. Das Video erzählt eine persönliche und emotionalisierende Geschichte über Armut bei Rentnern. Die Protagonisten sind KI-generiert und erfunden. Ein Beispiel aus einer Serie an Videos, die ähnlich funktionieren. "KI. Wie viele das glauben", macht sich ein weiterer User über andere lustig. Die Antwort: "Weil es die Realität ist."

Die Schwemme von KI-Fakes zeigt, was für Falschinformation seit jeher gilt: Häufig überzeugt sie uns nicht vom Gegenteil dessen, was wir glauben. Sondern sie bestätigt, was wir glauben wollen. Oft gefällt die Botschaft – sogar wenn man den Fake erkannt hat. Es geht nicht darum, was ein echter Beleg ist. Sondern darum, en masse Gefühle zu bestärken.

Kommentare zu KI-Videos auf TikTok: User halten auch erkannte KI-Fakes für "wahr".

AI Slop: Es geht nicht um "wahr oder falsch"

"Die Leute interessiert dann nicht, ob alle sehen, dass etwas schlecht drauf montiert ist oder offensichtlich KI", sagt Timo Lenk dem #Faktenfuchs. Er forscht an der TU Dortmund zu Informationsmanipulation und Desinformation. "Das geht weg von einer Wahr-Falsch-Kategorisierung."

Wie bei einem KI-generierten Video, das US-Präsident Trump verbreitete. Darin schüttet er aus einem Kampfjet eine braune Substanz – eine naheliegende Deutung: Fäkalien – über Protestierende. Lenk sagt: "Natürlich ist allen klar, dass das nicht wirklich passiert." In erster Linie gehe es aber um Gefühle – und Ideologie.

US-Präsident Trump verbreitet KI-Propaganda - wie dieses Video über sich selbst.

Solcher sogenannter AI Slop überschwemmt inzwischen Plattformen wie TikTok oder X regelrecht. Maria Pawelec ist Politikwissenschaftlerin, Expertin für Deepfakes und Desinformation und forscht am Internationalen Zentrum für Ethik in den Wissenschaften (IZEW). Sie sagt: Diese unrealistisch wirkenden KI-Darstellungen blieben, als visueller Eindruck, oft stärker hängen als reiner Text – und wirkten stärker auf die Gefühle.

Desinformation bestätigt häufig Weltanschauung

Propagandamaterial, das bestimmte Vorurteile repräsentiert, spiele eine große Rolle, sagt Lenk. Die Bilder oder Videos unterstellten etwa einer Person eine bestimmte Geisteshaltung oder ein bestimmtes Verhalten. Aber weil kein reales Material das zeige, werde das Vorurteil gewissermaßen untermalt.

Der Politikwissenschaftler Marcus Bösch forscht zu Propaganda, KI und digitalen Kommunikationsstrategien. In seinem Newsletter "Understanding TikTok" forderte er Ende März: "Stop calling it disinformation". Den Erfolg von Propaganda bestimme nicht mehr, ob etwas wahr sei oder auch nur überzeugend, schreibt er.

Postdigitale Propaganda forme, was wir sehen oder fühlen, was als Beweis gilt. Und sie forme, wie Realität bestätigt oder widerlegt werden könne – wenn sie zum Feed passt, das Gefühl trifft, aufgegriffen wird und sich wiederholt.

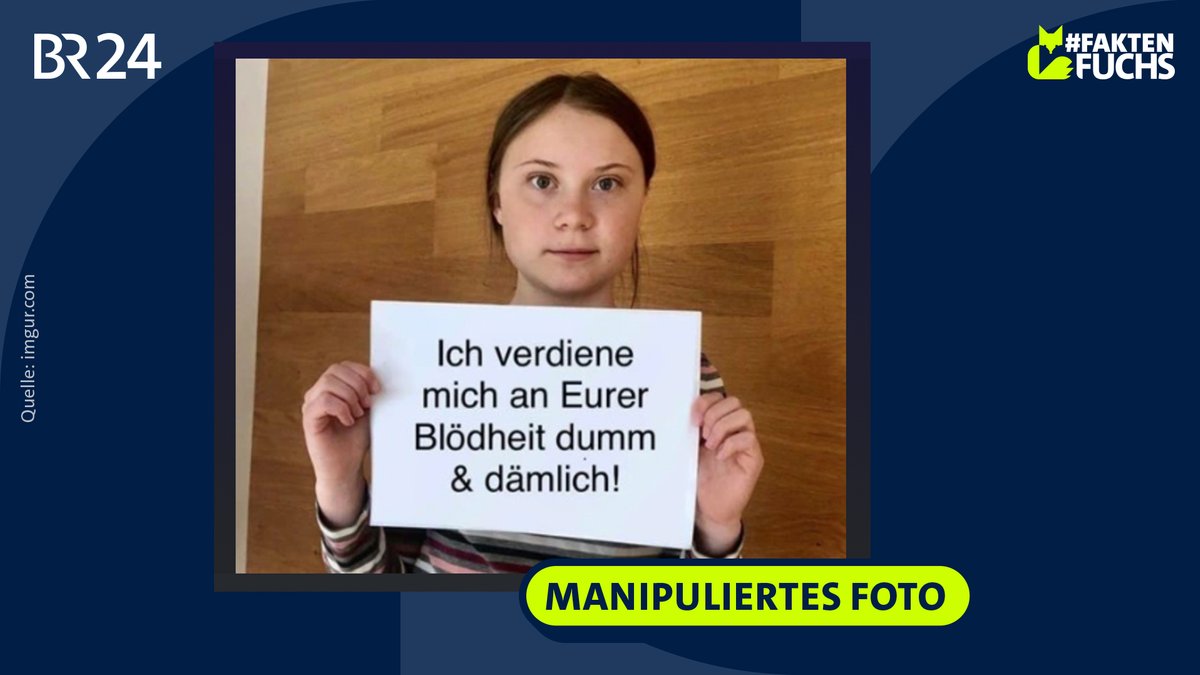

Fakes, ob per Photoshop oder per KI, müssen also nicht täuschend gut gemacht sein, um zu wirken. Das gilt seit Jahren. 2019 ging ein manipuliertes Foto von Greta Thunberg viral, bei dem erkennbar war, dass die Schrift auf ihrem Schild nachträglich eingefügt worden war. Dennoch wurde es sehr häufig geteilt – mit vielen Wut-Emojis.

Ein manipuliertes Bild von Greta Thunberg, das sehr häufig geteilt wurde.

Forscher haben eine Theorie, die das beschreibt: "gist based reasoning": von der Kernbotschaft geleitetes Denken. "Die Theorie besagt, dass Menschen Fake News nicht wortwörtlich glauben, also etwa dass Einwanderer Haustiere äßen. Sondern dass sie an den Kern glauben, also dass Einwanderer zwielichtig seien", schreibt Sander van der Linden an den #Faktenfuchs.

Der Sozialpsychologe forscht an der University of Cambridge. Die Leute wüssten, dass etwa Trumps Aussagen nicht wörtlich zu nehmen sind. "Aber sie fühlen sich richtig an für sie."

Ralf Hohlfeld, Kommunikationswissenschaftler an der Universität Passau, sagt: "In bestimmten Teilöffentlichkeiten ist den Leuten vollkommen egal, ob etwas faktisch wahr ist, ob es überprüfbar ist, sondern es muss ins Narrativ passen." Er nennt das "epistemische Indifferenz". Das heißt: Diese Menschen seien von einer Person oder Weltanschauung überzeugt. Was dazu nicht passe, sei ihnen egal, so Hohlfeld.

Abwertung mit unechten Bildern ist alte Praxis

Historisch ist die Taktik nicht neu, eindeutig unechte Propagandabilder zu verbreiten, so Timo Lenk von der TU Dortmund. Nationalsozialisten etwa wandten sie häufig bei der antisemitischen Darstellung von jüdischen Personen auf Propagandaplakaten an. "Das wird jetzt durch KI gepusht", sagt Lenk.

Für User unterstreichen solche Posts häufig das eigene Weltbild oder Freund-Feind-Denken, wie Pawelec sagt. Solche politischen Angriffe mobilisierten die eigene Anhängerschaft. Es gehe dabei oft ums Abwerten, Abgrenzen oder Lächerlichmachen von politischen Gegnern.

Gezielt verbreitete sexualisierende Deepfakes etwa müssen nicht realistisch aussehen. "Und selbst wenn sie realistisch aussehen – gerade wenn sie Politiker oder Politikerinnen ins Visier nehmen, glauben viele Leute trotzdem nicht unbedingt, dass das Material echt ist", sagt Pawelec. Wie auf dem KI-generierten Bild auf X, das Karl Lauterbach und Robert Habeck in Sado-Maso-Kleidung zeigt. User machen die Politiker in den Kommentaren lächerlich.

Desinformation spricht politische Zugehörigkeit an

"Dadurch wird Begeisterung ausgelöst und die eigene Identität, die Selbstdefinition gestärkt", sagt Politikwissenschaftlerin Pawelec. Dann könnten sich die User stärker zugehörig fühlen zu ihrer politischen "Ingroup" - also der Gruppe, zu der sie gehören und der sie sich verbunden fühlen.

Darum gehe es häufig auch, wenn User solche Inhalte weiterverbreiten: "Hauptsache, man zeigt, wo man ideologisch steht." Viele Kampagnen schließen die Reihen, sagt Kommunikationswissenschaftler Hohlfeld. Das Weltbild der Zielgruppe könne man vervollständigen und erhärten. "Aber den politischen Gegner wird man in der Regel damit nicht überzeugen."

Das Bedürfnis, sich politisch zugehörig und bestätigt zu fühlen, kann durchaus auch dazu führen, dass man den Fake nicht erkennt: indem man weniger kritisch hinsieht – und deshalb Bildfehler nicht wahrnimmt. Die Botschaft aber nimmt man auch dann bereitwillig auf. Auch hier gilt, wie Timo Lenk von der TU Dortmund sagt: Manipulative Botschaften verstärkten bestehende Einstellungen eher, als sie zu verändern.

Den kognitiven Mechanismus zu kennen, der hier Einfluss hat, kann helfen: Der Confirmation Bias oder Bestätigungsfehler bedeutet, dass wir eher ungeprüft glauben, was zu unserer Weltanschauung passt. Was nicht dazu passt, lehnen wir eher ab. "Wir alle sind in der Hinsicht verwundbar", sagt Hohlfeld und rät: "Meine Warnlampen müssen aufleuchten, wenn es zu eingängig ist, zu sehr genau das bedient, was wir als Weltanschauung für gut halten."

Auch wenn KI-Fakes täuschen, verstärken sie Überzeugungen

Während der Proteste gegen ICE-Einsätze in den USA kursierte etwa ein KI-generiertes Video von einem Gefährt in Form eines ausgestreckten Mittelfingers, das ICE-Kräften davonrast. Einige Kommentare zu dem Video zeigen: Das feierten besonders Menschen, die gegen Trumps ICE-Politik waren und deren Meinung das Video entsprach.

"Sie können nicht einmal rennen mit ihrer ganzen Ausrüstung", schrieb eine Userin über die KI-Einsatzkräfte, begleitet von Lach-Emojis. Sie hat offenbar nicht erkannt, dass das Video nicht echt ist.

Screenshot von einem KI-generierten Video zu Protesten gegen ICE-Kräfte in Minneapolis.

Wie man sich vor Manipulation schützt

Manche, die Falschinformationen glauben, würden aus ihrer Weltanschauung heraus tatsächlich sagen: "Ich suche nach der Wahrheit". Aber, sagt Hohlfeld: "Sie arbeiten mit anekdotischer Evidenz." Das heißt, sie picken einzelne Fälle oder Erfahrungen heraus, die ihre These untermauern. Gegensätzliche Beweise ignorieren sie.

"Sie machen sich immun gegenüber der empirischen Evidenz. Da kann man nicht sagen, dass für diese Menschen Wahrheit keine Rolle mehr spielt – sie haben die Wahrheiten einfach verdreht." Forscher streben hingegen nach empirischer Evidenz – sie versuchen mithilfe wissenschaftlicher Methoden, ein möglichst vollständiges Bild der Realität zu erlangen.

Wie merke ich, dass ich manipuliert werde?

Wichtig sei es, zu erkennen, worauf ein verdächtiger Post abzielt, sagt Timo Lenk. "Habe ich es mit einer Manipulation zu tun, die auf Emotionen abzielt? Das muss ich merken, dann kann ich mich dagegen wappnen." Bisweilen fallen wir einem Effekt zum Opfer, den die Psychologie "motivated reasoning" nennt: Wir suchen vernünftig klingende Argumente für eine emotionale Entscheidung, die wir bereits getroffen haben.

Auch der "illusory truth effect" habe Einfluss, sagt Pawelec. Wir halten Dinge eher für wahr, die wir häufiger gesehen oder gehört haben, als neue Informationen. Einfach nur, weil sie uns bekannt vorkommen. Menschen halten außerdem Dinge eher für richtig, die auch ihr Umfeld für richtig hält, so die Politikwissenschaftlerin.

Ziele sind vielfältig – ein Ziel kann auch sein, User umzustimmen

Sozialpsychologe van der Linden betont aber, man dürfe die große Mitte nicht vergessen: "Propaganda kann viele Menschen, die zum Beispiel in Bezug auf den Klimawandel oder Impfungen unentschieden sind, auf die eine oder andere Seite schwingen lassen, weil ihre Sicherheit in Bezug auf ihre Überzeugungen so niedrig ist."

So verbreitete Trump im US-Präsidentschaftswahlkampf KI-Bilder von Kamala Harris als Kommunistin. Experten, die den kulturellen Kontext in den USA beobachten, erkannten darin das Motiv, Wähler etwa mit kubanischem oder venezolanischem Hintergrund zu überzeugen, nicht Harris zu wählen. In den USA leben viele, die vor den sozialistischen Regimes in Venezuela und Kuba geflohen sind.

Informationsflut soll gezielt Unsicherheit stiften

Gerade in der Masse von Desinformation liegt aber noch ein weiteres Kernmotiv: "In vielen Fällen versucht Desinformation, ein epistemisches Chaos zu erzeugen", sagt Timo Lenk. Sprich: Wir sollen nicht mehr sicher sein, was wir überhaupt noch wissen können. Diese Verunsicherung der Bevölkerung ist eine Wirkung, die immer mitschwingt. "Flood the zone with shit", diese Strategie benannte Steve Bannon, Ex-Berater von US-Präsident Trump.

Das sei oft ein explizites Ziel von Akteuren, die Desinformation verbreiten – ausländisch oder nicht, sagt Pawelec. Das Vertrauen der Bevölkerung in Medien, also Bilder, Videos, Audiodateien, soll erschüttert werden – und damit auch in demokratische Prozesse und Strukturen, also zum Beispiel in Wahlen.

Das kann auch dazu führen, dass sich Bürger von der Politik und von Wahlen fernhalten. Hohlfeld, der Passauer Kommunikationswissenschaftler, sagt es so: "Wenn ich sie oft genug ins Zweifeln bringe, dann werden sie vielleicht bei irgendeiner Situation sagen: 'Mensch, dann gehe ich halt nicht zur Wahl.' Da ist durchaus ein gewisses Kalkül vorhanden." Dafür lohne es sich für die Akteure, in Kampagnen zu investieren.

Fazit

Fakes müssen nicht gut gemacht sein, um zu funktionieren. Es geht oft nicht darum, zu überzeugen – oder um Kategorien von "wahr" oder "falsch". Auch Bilder oder Videos, die nicht täuschend echt wirken, können ein Hauptziel von Propaganda oder Desinformation bewirken: dass sich Menschen in ihrer Sicht auf die Welt und bestimmte Gruppen bestätigt fühlen. Doch auch unsichere Menschen umzustimmen, ist ein mögliches Motiv.

Quellen:

Interviews/Presseanfragen:

Ralf Hohlfeld

Timo Lenk

Sander van der Linden

Maria Pawelec

Veröffentlichungen

American Psychological Association, Using psychological science to fight misinformation: A guide for journalists

BBC, Why 'Comrade Kamala' memes are spreading among Latino exiles

Bösch, Marcus, "Stop calling it disinformation"

BR24 #Faktenfuchs: Virale KI-Fakes zu ICE-Einsätzen in den USA

Correctiv, Manipuliertes Foto von Greta Thunberg wird zehntausendfach geteilt

Current Opinion in Psychology, Misinformation and the epistemic integrity of democracy

Klimafakten, Über Klima Sprechen, das Handbuch. Kenne Dich selbst – und Deine Schwächen

Journal of Applied Research in Memory and Cognition, Combatting misinformation requires recognizing its types and the factors that facilitate its spread and resonance.

Journal of Communication, Media stereotypes, prejudice, and preference-based reinforcement: toward the dynamic of self-reinforcing effects by integrating audience selectivity

Political Communication, Disinformation as Political Communication

Proceedings of the National Academy of Sciences of the United States of America, A scientific theory of gist communication and misinformation resistance, with implications for health, education, and policy

Proceedings of the National Academy of Sciences of the United States of America, Nazi indoctrination and anti-Semitic beliefs in Germany

Proceedings of the National Academy of Sciences of the United States of America, Susceptibility to online misinformation: A systematic meta-analysis of demographic and psychological factors

Snopes, Trump posted AI video of him poop-bombing protesters? The headline says it all, really.

The Guardian, Foolproof by Sander van der Linden review – how to defuse fake news

The International Journal of Press/Politics, The Consequences of Evidence- Versus Non-Evidence-Based Understandings of the "Truth": How Russian Speakers in Germany Negotiate Trust in Their Transnational News Environments

"Hier ist Bayern": Der BR24 Newsletter informiert Sie immer montags bis freitags zum Feierabend über das Wichtigste vom Tag auf einen Blick – kompakt und direkt in Ihrem privaten Postfach. Hier geht’s zur Anmeldung!